这项由NVIDIA、多伦多大学和悉尼大学联合开展的研究,以预印本形式发布于2026年4月,论文编号为arXiv:2604.09860v2。有兴趣深入了解的读者可通过该编号在arXiv平台查阅完整论文。

一、一场关于"机器人究竟有多聪明"的考试

假设你雇了一位家政助理,面试时他表现得天花乱坠,但真正到你家干活,却总是把厨房搞得乱七八糟,或者把你的橙子放进垃圾桶。这种"考场优秀、实战拉垮"的困境,正是当前机器人研究领域面临的核心难题。

近年来,研究人员开发出了一批被称为"通用机器人策略"的智能系统,就像一个能听懂各种指令、完成各类任务的机器人管家。这些系统在论文里的成绩通常非常亮眼,但当真正把它们放到现实场景中测试时,却往往令人失望。问题出在哪里?

关键在于"考试卷子不对"。现有的机器人测试平台,大多让机器人在它曾经训练过的场景里考试。这就好比一个学生把历年真题全都背了个遍,然后参加一场几乎原题复现的考试——高分自然是手到擒来,但这并不能说明他真的学懂了数学。

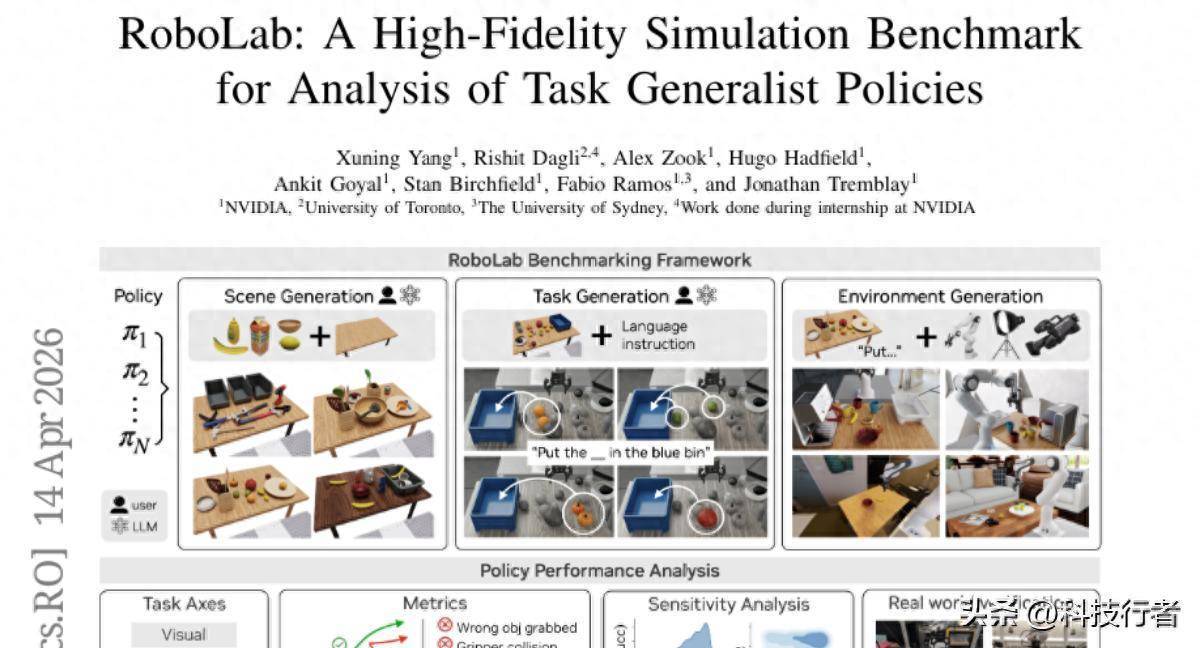

NVIDIA领衔的研究团队意识到这个问题,于是专门设计了一个全新的"考场"——RoboLab。这个平台的目标只有一个:让机器人在从未见过的场景里接受真实能力的检验,彻底杜绝"背题作弊"的可能性。结果发现,目前公认最先进的机器人系统,在这个考场里的成功率只有大约30%,相当于一百道题只答对了三十道。这个数字像一盆冷水,泼醒了对当前技术过于乐观的人们。

二、机器人的"模拟考场"为什么总是不靠谱

在介绍RoboLab之前,有必要先说清楚,为什么之前的模拟测试平台总是无法真实反映机器人的能力。

传统的机器人测试分成两大类,各有各的硬伤。第一类是"纯模拟"测试,就是在计算机里建造一个虚拟世界,让机器人在里面练习和考试。这类方法成本低、效率高,但致命缺陷是画面太粗糙、物理效果太失真。机器人在这里学到的技能,换到现实世界里往往完全失效——就像一个只在游泳池里学过游泳的人,突然被扔进波涛汹涌的大海,立刻手足无措。这就是业界常说的"仿真到现实的迁移鸿沟"。

第二类是"现实转仿真"测试,研究者先用真实相机拍摄真实场景,再用高级技术把真实影像融入虚拟环境,使得画面极度逼真。代表性技术包括高斯泼溅(一种让虚拟场景看起来和真实照片几乎无法区分的技术)。然而,这种方法的代价是时间成本极其高昂——每构建一个测试场景就需要大约一个小时,根本无法大规模扩展。更重要的是,构建出来的场景高度依赖已有的真实场景照片,难以灵活创建全新的、机器人从未见过的测试环境。

RoboLab走的是一条中间路线:画面逼真程度足够高,让机器人感受到类似真实世界的视觉信息;同时生成新场景的速度极快,几分钟内就能完成,而不是一个小时。更关键的是,所有用于测试的场景都是机器人在训练时完全没有接触过的全新环境。这就像学校每次期末考试都出全新题目,而不是从题库里重复抽题,才能真正考出学生的实际水平。

三、RoboLab究竟是一个怎样的"考场"

RoboLab的设计可以从三个角度来理解:它用什么样的"考场"、它出什么样的"题目"、它用什么样的"评分标准"。

在搭建考场方面,RoboLab提供了一套高度灵活的场景生成流水线。工作人员可以亲手摆放虚拟物品、设定位置,也可以用自然语言向一个人工智能语言模型提出要求,比如说"帮我生成一个杂乱的厨房操作台",系统就会自动规划物品布局、检查物品是否会相互穿插或倒塌、再进行物理模拟确认场景稳定。整个过程通过三个步骤反复迭代:先由语言模型生成摆放方案,再由几何求解器把这个方案转换成具体的空间坐标,最后在虚拟物理引擎中运行三百步来检验物品是否会因为重力而倒塌。如果有物体滑落或不稳,系统会把错误信息反馈给语言模型,要求重新规划,直到整个场景稳定为止。依靠这套机制,研究团队已经批量生成了超过八百个各具特色的虚拟场景。

在出题方面,RoboLab-120基准测试包含120道精心设计的测试题,覆盖三个维度的能力考察。第一个维度叫做"视觉能力",考查机器人能不能准确识别颜色、大小和物体类别,比如"把黄色的物品放进左边的箱子"。第二个维度叫做"程序能力",考查机器人能不能完成需要特定动作顺序的任务,比如"把白色杯子立起来,开口朝上"或者"把两个碗叠起来"。第三个维度叫做"关系能力",考查机器人能不能理解语言中隐含的逻辑关系,比如"把锤子或者锉刀放进右边的箱子"(注意这里有"或者"的逻辑),以及"拿出两个苹果"(需要计数)。120道题被分成三个难度等级:65道简单题、38道中等题、18道复杂题,难度差异不仅体现在所需步骤的多少,还体现在语言指令的复杂程度上。

在评分标准方面,RoboLab彻底抛弃了过去那种"成功就是1分、失败就是0分"的粗放评判方式,引入了一套更加细腻的打分体系。对于需要多个步骤完成的任务,系统会记录每个子任务完成了多少,最终算出一个连续的得分而非简单的成功失败。与此同时,系统还会自动记录执行过程中出现的各种错误:机器人有没有抓错物品、物品有没有中途掉落、机器手有没有和周围环境发生碰撞。此外,系统还会分析机器人的运动轨迹质量,评估动作是否流畅、路径是否最优。一个动作极其跌撞、颤抖不止但最终歪打正着完成任务的机器人,和一个动作行云流水、一气呵成的机器人,在这套评分体系下会得到截然不同的评价,哪怕它们的最终任务结果相同。

四、让机器人做"敏感性体检":什么因素最容易让它出错

RoboLab最有创意的功能之一,是一套专门用来分析机器人"弱点"的工具,研究团队称之为"敏感性分析"。

这种分析的思路类似于医院里的压力测试。医生有时会故意让心脏病患者在跑步机上跑步,同时监测心电图,借此发现在静息状态下无法发现的隐患。RoboLab的敏感性分析同样如此:研究者系统地改变测试环境的各个参数,观察机器人的成功率如何随之变化,从而找出哪些因素对机器人的表现影响最大。

具体而言,研究团队测试了四类变化。第一类是灯光变化,包括整体调暗、打上强烈的方向性阴影、调整色温使画面偏暖或偏冷,以及过度曝光。第二类是视觉外观变化,包括更换桌面纹理(木纹、大理石纹等)和替换背景图像(不同的房间环境)。第三类是物体位置变化,把目标物体向机器人靠近或远离,分别测试偏移10厘米、20厘米、30厘米时的表现差异。第四类是摄像头位置变化,分别测试安装在机器人手腕上的"腕部摄像头"和安装在外部支架上的"外部摄像头"在位置发生偏移时的影响。

为了精确量化这些影响,研究团队使用了一种叫做"混合神经后验估计"的数学方法。简单说来,这种方法会学习出一种映射关系:给定某个环境参数的取值,任务成功的概率有多高?通过分析这个映射关系,就能清楚地看到机器人最"怕"哪种变化。

结果出人意料,又在情理之中。机器人对灯光变化的适应能力相当强,无论是调暗、产生阴影还是过度曝光,成功率几乎没有明显下降,这说明这些机器人确实在不同光照条件下的训练数据中磨练过。背景和桌面纹理的变化影响也不大,下降幅度不超过5%。然而,腕部摄像头的位置一旦偏离标准位置,任务成功率就会急剧下滑。分析结果显示,腕部摄像头越接近训练时的标准安装位置,成功率就越高,哪怕只偏移了几厘米,效果也会显著变差。相比之下,外部摄像头的位置变化对成功率的影响要小得多。物体距离方面,成功率在物体距机器人约0.5米时达到峰值,推测是因为这个距离在机器人手臂的最适合抓取范围内。

五、五位"选手"同台竞技,成绩却触目惊心

研究团队选取了目前业界公认最先进的五个机器人智能系统参加RoboLab-120的测试,它们全部在一个名为DROID的大规模真实世界机器人操作数据集上进行过训练,测试所用的机器人硬件也与DROID数据集的配套硬件保持一致:一台有七个自由度的Franka Panda机械臂,配备一个夹爪、一个外部摄像头和一个腕部摄像头。

五位参赛者中,成绩最好的是Physical Intelligence公司开发的π0.5,这是一个视觉-语言-动作一体化模型,专门为开放世界的通用任务设计。排在第二的是π0-FAST,同样来自Physical Intelligence,是π0的一个更快版本。π0则是π0-FAST的前一代模型。PaliGemma是谷歌开发的一个多模态视觉语言模型,并非专门为机器人操作设计。GR00T N1.6是NVIDIA自家的开源通用人形机器人基础模型。

测试结果令人深思。成绩最好的π0.5整体成功率为23.3%,也就是说在120道题里大约只答对了28道。π0-FAST的成功率是15.7%,π0是5.2%,GR00T N1.6只有2.0%,PaliGemma垫底,仅有1.5%。这些数字与这些系统在各自发布的论文中声称的成绩相比,形成了鲜明的落差——但这恰恰说明RoboLab在避免"背题作弊"方面起到了它应有的作用。

从不同能力维度来看,π0.5在"关系能力"方面表现相对较好,正确处理"A和B"这类组合指令的成功率达到56.2%,数数能力(比如"拿出两个苹果")的成功率是50%,但理解"左边"、"前面"等空间关系的成功率只有19%。在视觉识别方面,颜色识别成功率17.3%、物体类别识别18.3%、大小区分13.3%,整体偏低。程序能力方面最差,重新摆放姿态(比如把杯子扶正)的成功率只有16.7%,叠放任务只有15%,抓取特定抓取点的任务只有13.3%。

这些数字揭示了一个规律:现有的机器人系统在处理相对明确、直白的组合指令时表现尚可,但一旦需要精细的视觉辨别、空间语言理解或者需要精确操作特定位置,成功率就会急剧下滑。

六、语言指令的细节差异,足以让机器人彻底蒙圈

RoboLab的研究团队还专门进行了一系列对照实验,探究语言描述方式的变化如何影响机器人的表现。这些实验揭示了当前机器人系统在语言理解方面令人担忧的脆弱性。

第一组实验测试了指令精确程度的影响。以"把白色的杯子放进灰色箱子里"这个任务为例,研究团队设计了三种说法:最具体的是"把白色的杯子放进灰色箱子里",稍微模糊一点的是"把杯子放进箱子里",最模糊的是"把杯子收好"。结果显示,π0.5在三种说法下的成功率分别是80%、90%(这里有趣的是模糊指令反而更高)和0%。当被要求"清空灰色箱子"时,π0.5甚至会错误地去抓箱子本身,而不是清除箱子里的内容物。这说明机器人并没有真正理解"清空"这个词的含义,只是做了浅层的关键词匹配。

第二组实验测试了场景中物体数量增加时的表现变化。当需要把一个罐头放进箱子时,π0.5的成功率是70%;需要把两个罐头都放进去时,下降到30%;需要放三个时,只剩20%。更有意思的是错误模式:当被要求打包"盒装食品"时,系统会频繁去抓圆柱形的罐头,因为罐头的形状和它见过的某些盒子相似,训练时积累的形状偏好盖过了语言指令的信息。这揭示了当前系统的一个根本缺陷:视觉形状的偏见有时会强到足以凌驾于语言描述之上。

第三组实验在固定场景中切换不同任务。比如同一个包含螺丝刀、锤子、夹钳的工具场景,被要求"把蓝色锤子放到桌上"时π0.5成功率为0%,而被要求"把无线电钻放到桌上"时成功率高达70%。错误分析显示,系统反复把视觉上相似的干扰物(比如夹钳、红色锤子)当成目标物体抓取。这证明机器人的语言理解高度依赖于训练时的语言-物体配对模式,遇到不熟悉的配对就会失灵,并非真正意义上的灵活语言理解。

对比不同难度等级,π0.5的简单题成功率26.3%、中等难度23.2%、复杂任务只有11.7%,任务越复杂、涉及步骤越多,成功率就越低,符合直觉预期。

七、模拟与现实的对比:仿真够不够"真"

所有这些分析都建立在一个前提上:在仿真里的表现能在多大程度上预测真实机器人的表现?研究团队专门针对六个简单任务在真实机器人上重复了测试,将结果与仿真测试进行对比。

π0.5在真实场景下的成功率是79.5%,在仿真中是74%,两者相差不大,说明仿真对这个系统来说是相当可靠的代理指标。π0-FAST在真实场景下是34.1%,仿真中是42%,差异稍大一些,但方向一致。然而,π0是一个明显的例外:它在真实场景下的成功率高达63.2%,而在仿真中只有18%。研究团队的定性分析认为,π0的特点是非常擅长稳定抓取单个物体,而RoboLab的真实机器人测试恰好选了六个主要以单物体抓取为核心的简单任务,因此在真实场景下成绩亮眼,但在覆盖面更广的仿真基准上则难以发挥优势。

这个结果说明,仿真测试并不能保证对所有机器人系统都是完美的代理,但对于综合能力均衡的系统,仿真成绩能够较为可靠地反映真实表现。研究团队也坦诚地在论文中指出,仿真与现实之间仍存在一定的视觉分布差异,这个差距需要通过更大规模的真实世界验证来进一步理解和量化。

八、这套"考场"本身的局限性

任何一项研究都有其边界,RoboLab也不例外。研究团队在论文中直接点明了几个值得关注的局限性。

RoboLab目前的测试场景全部聚焦于桌面上的刚体物品操作,比如抓取、放置、叠放等。对于软性物体(比如布料、电线、袋子)的操作,现有的物理模拟引擎精度有限,无法提供足够真实的测试环境。同样,需要精细力控的任务(比如拧螺丝、插插头)也超出了当前平台的覆盖范围,因为这类任务对接触力的精度要求很高,仅凭视觉信息难以完整模拟。此外,尽管研究团队已经做了相当大的努力来提高视觉逼真度,仿真画面与真实世界相机采集的画面之间仍然存在一定差距。

这些局限性并不意味着平台没有价值,而是提醒我们在解读测试结果时保持适度的清醒——就像一套数学考卷,再好也测不出学生的语文水平。

归根结底,RoboLab的意义不仅仅在于它给出了一批让人清醒的成绩单,更在于它提供了一种全新的思维方式:真正的通用机器人能力,应该在它从未见过的场景里接受检验,而不是在熟悉的"考题"上刷出漂亮的分数。

目前最先进的机器人系统在RoboLab上只有30%左右的成功率,这意味着研究者们需要在更强的视觉泛化能力、更深层的语言理解能力和更鲁棒的操作技能上继续下功夫。特别是视觉形状偏见问题、空间语言理解缺陷以及摄像头标定敏感性,都是亟需突破的具体方向。对于关心机器人技术走向的普通读者来说,下次听到某个机器人系统"成功率高达90%"这样的宣传时,不妨多问一句:这90%是在什么样的考场里考出来的?

有兴趣深入钻研细节的读者,可以在arXiv平台以编号2604.09860查询原始论文,里面包含完整的技术细节、所有实验数据以及附录中的扩展测试结果。

---

Q&A

Q1:RoboLab测试和普通机器人仿真测试有什么区别?

A:普通仿真测试通常让机器人在训练过的场景里考试,相当于"押题考试",成绩好并不代表真实能力强。RoboLab专门生成机器人从未见过的全新场景,同时画面逼真度足够高,几分钟内就能生成一个完整场景。目前最好的机器人系统在这套考场里的成功率只有23%左右,而在普通测试中往往能达到80%以上。

Q2:RoboLab发现当前机器人最大的弱点是什么?

A:研究发现了几个关键弱点。第一是腕部摄像头位置稍微偏移,成功率就会大幅下降,说明机器人对摄像头安装精度极度敏感。第二是语言理解很浅——机器人更像在做关键词匹配,而非真正理解指令含义,比如被要求"清空箱子"时会去抓箱子本身。第三是视觉形状偏见严重,比如被要求拿盒子时会去抓形状相似的罐头,训练数据积累的视觉偏好会凌驾于语言描述之上。

Q3:RoboLab生成测试场景的流程是怎样的?

A:RoboLab使用三步流程自动生成场景。首先,向大语言模型描述一个场景主题,比如"杂乱的厨房操作台",模型会规划物品的摆放方案和空间关系。然后,几何求解器把这个方案转化成具体的空间坐标,处理物品之间不能相互穿插等约束。最后,在虚拟物理引擎中模拟重力,检查物品是否会倒塌,不稳定的情况会反馈给模型重新规划,直到场景稳定为止。整个过程只需几分钟,已生成超过800个不同场景。

中金汇融提示:文章来自网络,不代表本站观点。